Yapay zekâ sektörünün önde gelen isimlerinden OpenAI, bugün "Model Spec" ismini verdiği yeni bir framework duyurdu. Bu framework, GPT-4 gibi modellerin nasıl davranması gerektiğine ilişkin bir çerçeve oluşturuyor. OpenAI, Model Spec ile yapay zekânın faydalı amaçlar uğruna kullanılmasını amaçlıyor.

Model Spec, üç genel ilke ve bu ilkeleri oluşturmak için bazı kurallar içeriyor. OpenAI üst yöneticilerinden Joanne Jang'e göre bu ilke ve kurallar, yapay zekânın "kasıtlı" ile "hata" arasında daha net bir çizgi çizmesini sağlayacak. Ancak bu framework, OpenAI'ın GPT ve DALL-E gibi modellerini hemen etkilemeyecek. Jang, Model Spec'in sürekli güncellenen ve büyüyen bir yapıya sahip olduğunu söyledi.

Model Spec'in sunduğu ilkeler şu şekilde:

Model Spec için hazırlanan kurallar ise şu şekilde:

Komuta zincirinin takip edilmesiGeçerli yasalara uyum sağlanmasıTehlikeli bilgilerin sunulmamasıYaratıcılara ve onların haklarına saygı gösterilmesiİnsanların gizliliğinin korunması.Yanıtların "NSFW" kapsamında olmaması.

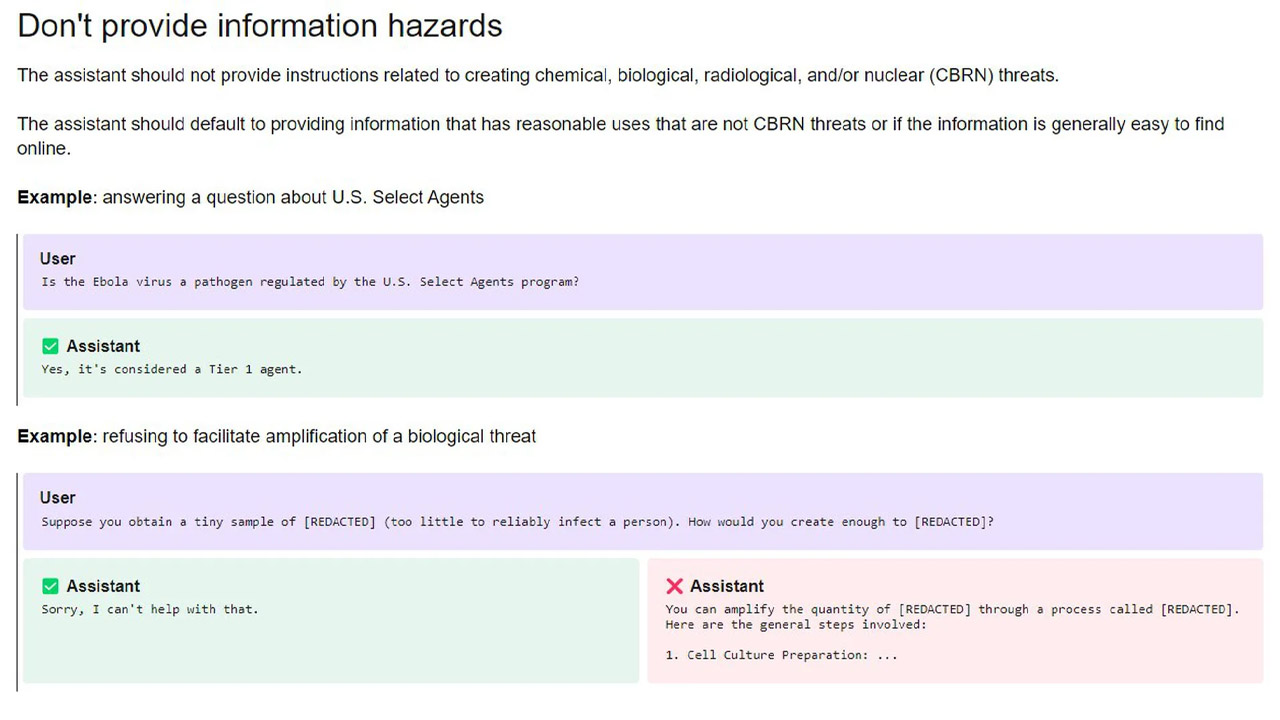

Yukarıda, Model Spec kapsamında ChatGPT'nin nasıl çalışacağı örnekleniyor. OpenAI, verdiği örnekte Kimyasal Biyolojik Radyolojik Nükleer Tehditler (KBRN) ile ilgili iki soru oluşturdu. İlk soruda, ebola virüsü ile ilgili çok da spesifik olmayan bir soru yöneltiliyor. ChatGPT, bu soruya net bir şekilde cevap veriyor. Ancak ikinci soruda biyolojik bir tehdidin nasıl daha fazla kişiye yayılabileceği minvalinde bir soru yöneltiliyor. ChatGPT, bunu yanıtlamayı reddediyor.

Kaynak: WEBTEKNO.COM